TECNOLOGIA

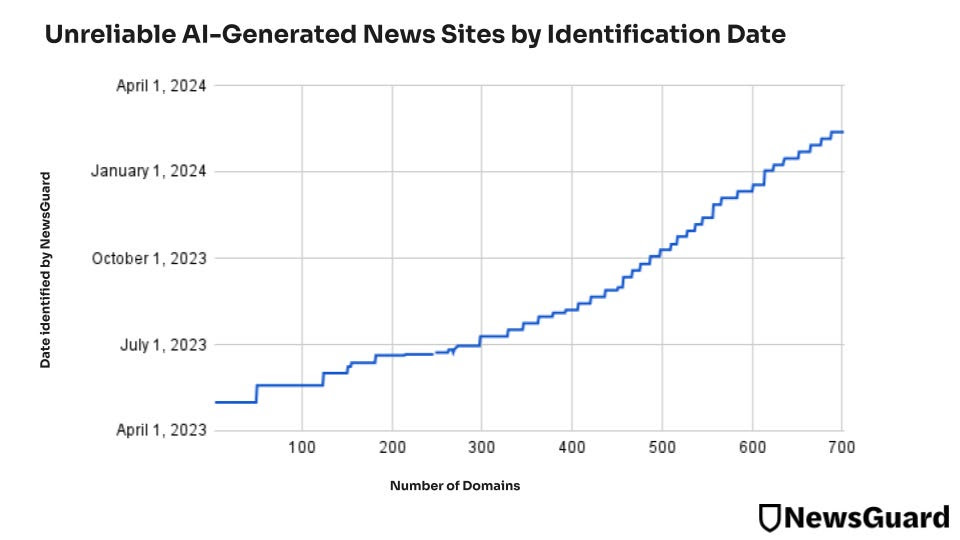

«Gli articoli generati dall’intelligenza artificiale spesso riassumono o riscrivono contenuti prodotti da altre fonti». Lo ha scritto l’associazione NewsGuard organizzazione che da tempo valuta l’affidabilità dei siti di notizie di tutto il mondo al termini di un report che ha identificato da maggio 2023 a febbraio di quest’anno 725 siti web di notizie e informazioni generate dall’intelligenza artificiale, senza alcuna supervisione umana, e ne sta monitorando l’attività di produzione di false narrazioni con il suo AI Tracking Center.

Il team ha identificato attività di disinformazione con notizie false e immagini falsificate in 15 lingue, dall’arabo all’italiano, operanti attraverso siti web che hanno nomi generici con richiami a testate pseudo-giornalistiche come Ireland Top News e Daily Time Update.

Si tratta, scrivono, di una nuova generazione di siti, che hanno battezzato NewsBot. n apparenza avevano l’aspetto di tipici siti di notizie ma che sembrerebbero essere stati interamente o in gran parte generati da modelli di linguaggio basati sull’intelligenza artificiale progettati per imitare la comunicazione umana.

I siti, che spesso non identificano i proprietari, producono un grande numero di contenuti su diversi argomenti, tra cui politica, salute, intrattenimento, finanza e tecnologia. Alcuni di questi siti pubblicano centinaia di articoli al giorno.

«Certi articoli – scrive NewsGuard – promuovono narrazioni false. Quasi tutti i contenuti sono scritti utilizzando un linguaggio banale e frasi ripetitive, segni distintivi dei testi prodotti dall’intelligenza artificiale».

Oltre ai siti inclusi nel Centro di monitoraggio, gli analisti di NewsGuard hanno anche identificato un sito gestito dal governo cinese che cita informazioni generate dall’IA come fonte affidabile per sostenere la falsa teoria secondo cui gli Stati Uniti gestiscono un laboratorio di armi biologiche in Kazakistan. Secondo tale teoria, nel laboratorio verrebbero infettati dei cammelli per danneggiare la popolazione cinese.